はじめに——診察室で起きている、静かな革命

「最近、先生が私の話をちゃんと聞いてくれるようになった気がする」。

ある米国の患者が、診察を終えてそうつぶやいた。理由は単純で、医師がカルテに目を落とさなくなったからだ。代わりにポケットのスマートフォンが二人の会話を録音し、AI が同時にカルテの下書きを書いていた——医師はただ、患者の目を見ていればよかった。

これは未来の話ではない。Kaiser Permanente(米国最大の医療システムのひとつ)は 2024 年から 2025 年にかけて、ambient AI scribe(環境型 AI 書記)を 1 年で 250 万回以上利用した [16]。診察記録の作成時間として節約された累計は 15,700 時間を超え、医師たちはその時間を「患者と目を合わせる時間」に使った。

世界中の診察室で、AI が「もうひとりの同席者」として座り始めている。今日はその地殻変動を、医師の本音とエビデンスでお伝えしたい。診察室の中で何が起きていて、何が危うくなっていて、日本ではどう向き合おうとしているのか。

何が起きているのか——世界では月 250 万回、AI が医師の隣に座っている

「AI に書かせる」ではなく「AI が聞いている」——ambient AI scribe とは

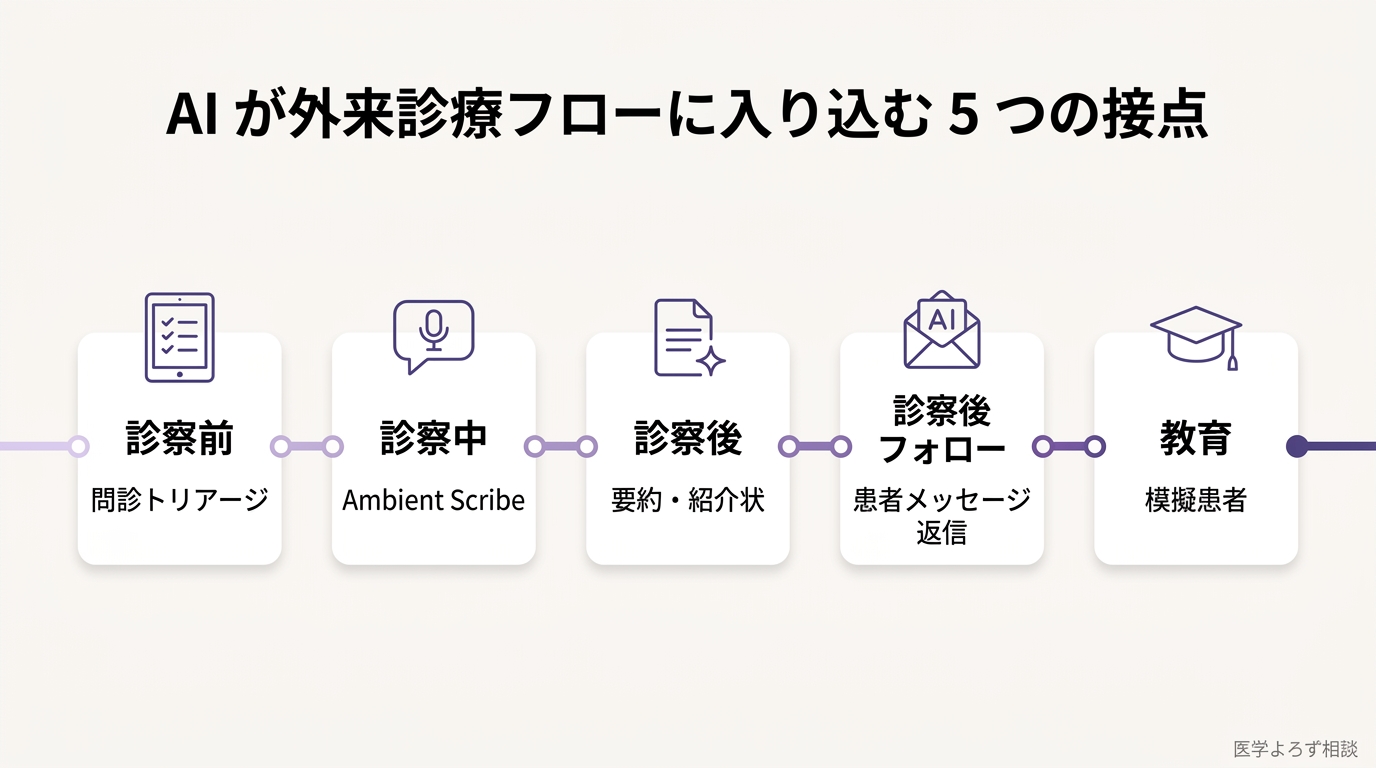

これまでの医療 AI は、画像診断 AI のように「医師が AI に判定させる」道具だった。だが 2024 年以降に急速に広まったのは、まったく別の使い方だ。

ambient AI scribe(環境型 AI 書記)と呼ばれるそれは、診察室の音声を常時聞き取り、医師と患者の会話そのものを構造化されたカルテ下書きに変える。医師は会話を終えた後、AI が作った下書きを 1 分ほどで校正してサインする。タイピングがほぼ消える。

米国 Microsoft の Dragon Copilot(旧 Nuance DAX Copilot)は、2024 年時点で 400 を超える医療組織に導入され、Northwestern Medicine では医師の 50% 以上が患者対面で使用、記録時間は 24% 減、夜の "pajama time"(自宅で残務を片付ける時間)は 17% 減ったと報告されている。患者 1 人あたり平均 5 分以上の時間が浮き、医師の 77% が記録品質の改善を実感した。

これを RCT(ランダム化比較試験)で検証したのが UCLA Health の Lukac らだ [1]。238 名の外来医師を Microsoft DAX Copilot 群・Nabla 群・通常ケア群に 1 対 1 対 1 でランダム化したこの世界初の ambient AI scribe ピボタル試験は、Nabla 群で記録時間(time-in-note)の有意な削減を示し、両 AI 群でバーンアウト・タスク負荷・work exhaustion の改善傾向を確認した。

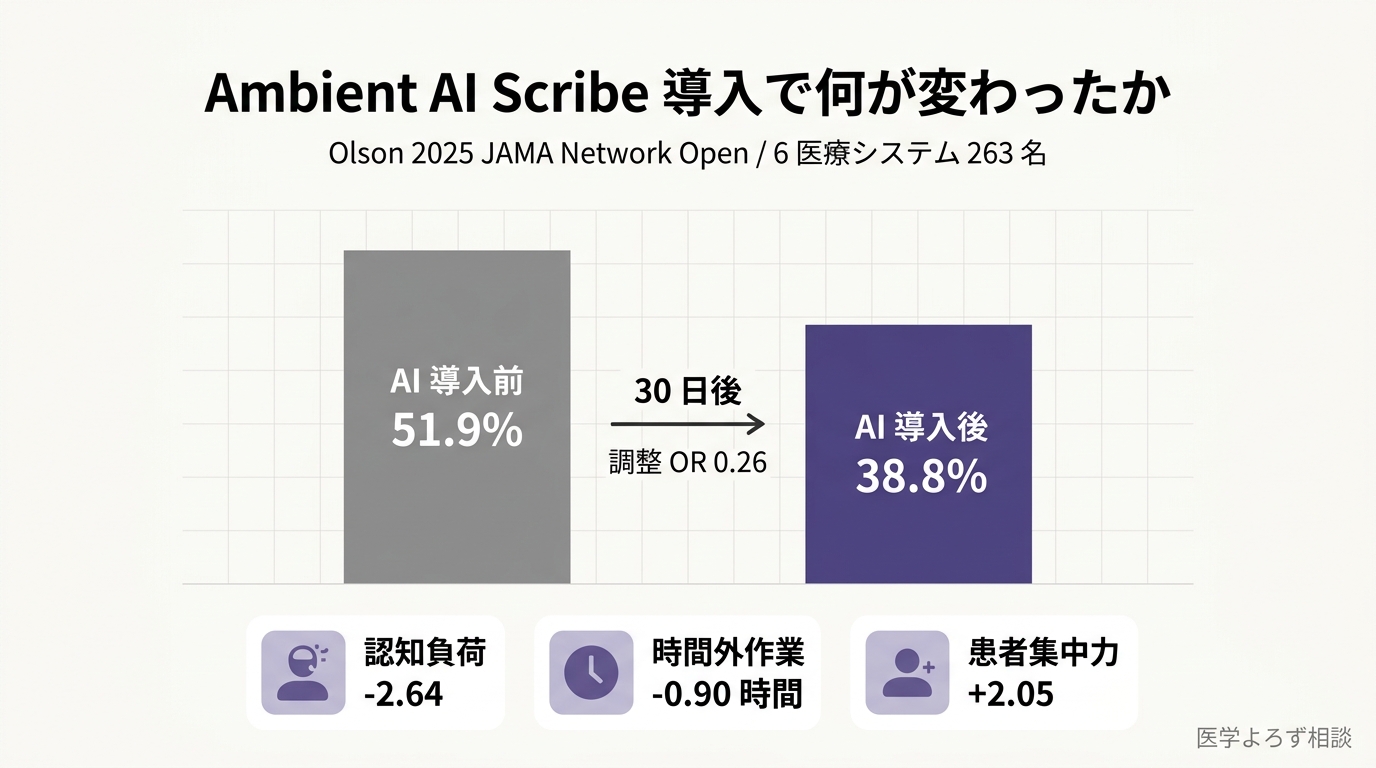

バーンアウト 51.9% から 38.8% へ——Olson 2025 の数字

もうひとつ重要な研究が、2025 年 10 月の JAMA Network Open に掲載された Olson らの 6 医療システム共同研究 [2]。Yale New Haven Health を含む 263 名の外来医師・APP(advanced practice provider)に ambient AI scribe を導入した前後で何が変わったかを測ったところ、結果はこうだった。

- バーンアウト率:51.9% → 38.8%(調整オッズ比 0.26、95%信頼区間 0.13-0.54、p<0.001)

- 認知タスク負荷:2.64 ポイント改善

- 診療時間外の記録作業:0.90 時間短縮

- 患者集中力:2.05 ポイント改善

「医師の 2 人に 1 人が燃え尽きていた職場が、3 人に 1 人になった」。それも 30 日で。AI スクライブは行政負担を減らし、臨床医により意味のある職務と専門的ウェルビーイングのための時間をもたらした、と著者らは結論した。

ChatGPT が患者の質問に医師より共感的だった衝撃

ambient AI scribe より前に世界を揺らした一本の論文がある。2023 年 6 月、JAMA Internal Medicine に掲載された UCSD の Ayers らの研究だ [4]。

研究チームは、Reddit の医療相談コミュニティ r/AskDocs に投稿された患者の質問 195 件を選び、本物の医師の回答と、ChatGPT に同じ質問を投げて得た回答を、評価者に盲検で比較させた。結果は衝撃的だった。

- 評価者が好んだ回答:ChatGPT 78.6%、医師 21.4%

- 「品質が良い」以上と判定された割合:ChatGPT が医師の 約 3.6 倍

- 「共感的」以上と判定された割合:ChatGPT が医師の 約 9.8 倍

なぜ AI のほうが共感的に見えたのか。答えはおそらく「時間」だ。AI には次の患者がいない。長く、丁寧に、患者の不安に寄り添って書ける。医師は 5 分の外来で次の患者が待っている。

Ayers らはこう述べている。「AI アシスタントが医師の患者メッセージ対応をどう改善できるか、探索が必要だ」。実際にその後 Epic(米国最大の電子カルテ)が GPT-4 を MyChart の患者受信箱に統合し、Stanford Medicine の 162 名の医師による QI 研究では、AI が作る下書きの採用率は 20%、医師のバーンアウト・感情的疲労が有意に減ったと報告された。150 を超える組織で月 100 万件以上の下書きが生成されている。

中国でも 35,418 件の外来受付会話を対象とした RCT が Nature Medicine に掲載され、看護師と LLM の協働モデルが受付業務の質を有意に高めた [6]。診察前の「聞き取り」「整理」「伝達」というインターフェース部分に、AI が静かに入り込み始めている。

何が危うくなるのか——AI が「便利すぎる」ことの代償

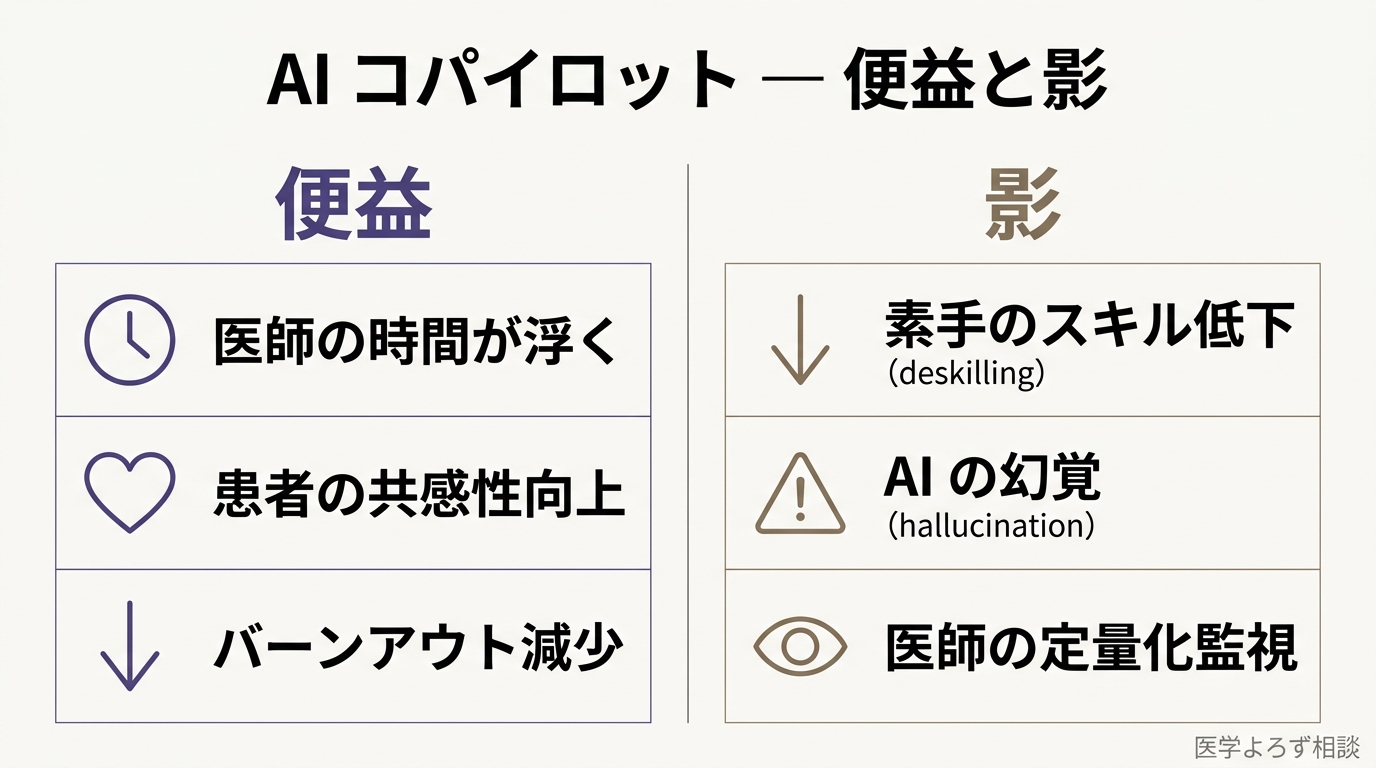

ここまで読むと、AI コパイロットは医師にも患者にも福音にしか見えない。だがエビデンスは、別の顔も同時に映し出している。

内視鏡医の素手のスキルが落ちた——Budzyń 2025 の警鐘

2025 年 8 月の Lancet Gastroenterology & Hepatology に、医療 AI の議論を一変させた観察研究が掲載された。ポーランドの 4 施設で、AI 内視鏡(大腸ポリープを自動検出する CADe)を導入した前後で、医師の "AI を使わない時" のパフォーマンスがどう変わったかを測った Budzyń らの研究だ [8]。

結果は予想外だった。AI 内視鏡に習熟した医師たちが AI を切ったとき、ポリープの検出率(ADR)が 28.4% → 22.4%(p=0.0089) と有意に低下した。「AI に頼って自分の目で探さなくなった」可能性が示唆された。

これは医学界に大きな衝撃を与えた。AI コパイロットは医師の負担を減らす一方で、長期的に医師の臨床判断力を蝕むかもしれない——deskilling と呼ばれるこの現象は、車のオートマ化でドライバーのマニュアル運転能力が落ちたのと構造的に同じだ。

観察研究のため因果関係は確定していない。だが「AI が無くなった日に、医師は素手で患者を救えるか」という問いは、もう避けて通れない。

AI は嘘をつく——hallucination の医療リスク

LLM の最も厄介な性質は、自信たっぷりに嘘をつくことだ。これを hallucination(幻覚)と呼ぶ。

2025 年 5 月の npj Digital Medicine で、英国の Tortus AI と Guy's and St Thomas NHS Trust のチームが、医療要約 LLM の hallucination を分類するエラー taxonomy と臨床安全評価フレームワークを発表した [9]。彼らは LLM が作る診察要約に「存在しない症状の追加」「指示された薬剤の誤記」「数値の入れ替え」といった臨床的に致命的なエラーが一定頻度で混入することを示し、医療機関での導入には系統的な監査が不可欠だと提言した。

JAMA Network Open に掲載された別の SR では、これまでに発表された 137 件の chatbot 健康助言研究のうち、99.3% が使用した LLM のバージョンを開示しておらず、99.3% がプロンプト設計を記述していない [5]。「AI の医療効果を評価する研究」自体が、再現性のない状態で量産されているのが現状だ。

「定量化された労働者」——AI に監視される医師

NEJM の 2025 年の Perspective が、もうひとつの影に光を当てた。診察中の会話が全部 AI 経由でメタデータ化されれば、保険会社・病院経営・規制当局がそれを使って医師を評価できてしまう。診察にかかった時間、患者への共感度、ガイドラインからの逸脱率——「医師は定量化された労働者になる」という警告だ。

さらに npj Digital Medicine の 2025 年ポリシーブリーフは、ambient AI scribe の普及で診療報酬請求のコーディング強度が上昇し、保険会社が downcoding(請求の減額査定)で対抗する「コーディング軍拡競争」が始まっていると分析した。AI が効率化を生むほど、別のところに歪みが移転する。

日本の今——医師法 17 条という枕木

ここまで世界の話をしてきた。では日本はどうか。

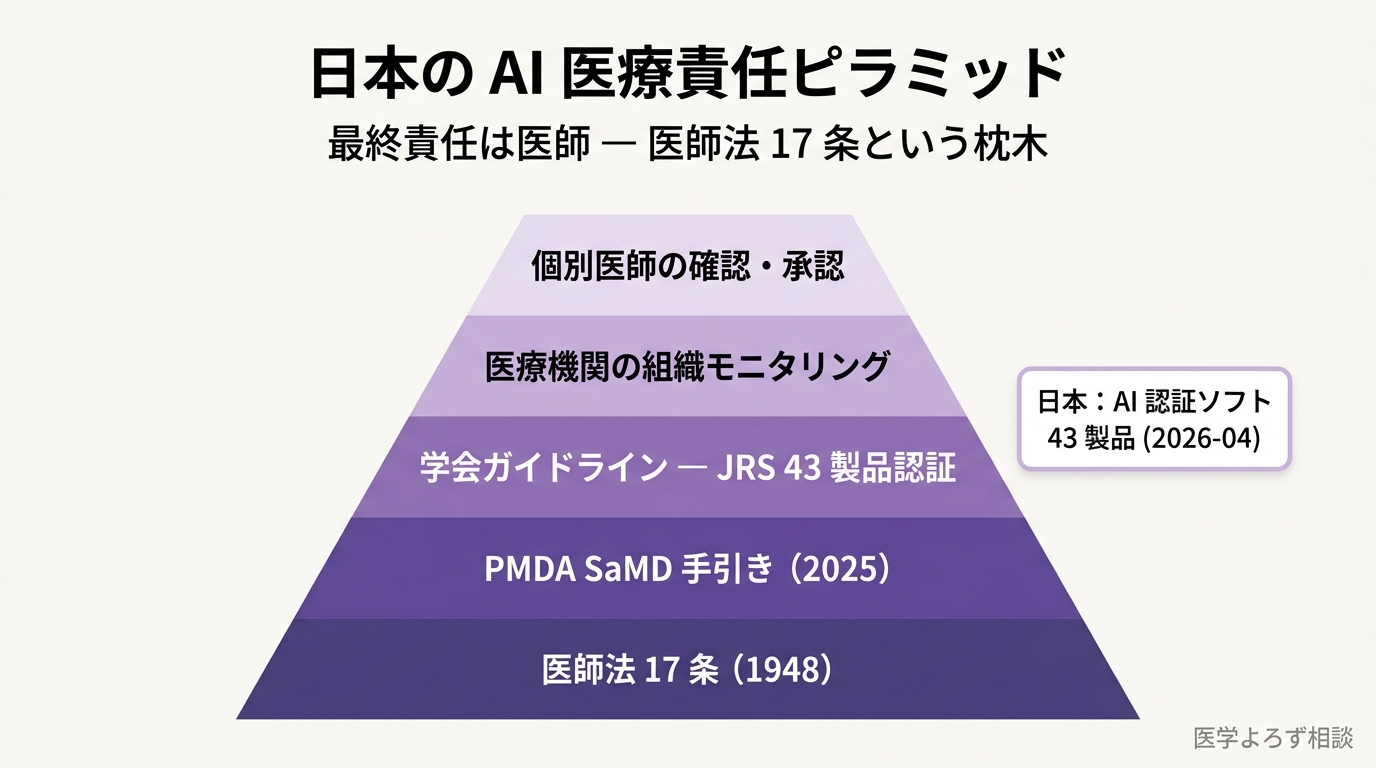

「最終判断は医師」——2018 年通知の重さ

日本には「医師法第 17 条」がある。「医師でなければ医業をなしてはならない」。シンプルな一文だが、これが医療 AI の議論のすべての出発点になっている。

2018 年 12 月 19 日、厚生労働省は「人工知能を用いた診断、治療等の支援を行うプログラムの利用と医師法第 17 条の規定との関係について」という通知を出した [13]。要点はこうだ。

AI を用いた診断・治療支援プログラムは「医師の判断を支援する補助ツール」と位置付け、最終判断の権限と責任は医師に帰属する。AI が単独で診断・治療判断を下すことは医師法 17 条違反となる。

2026 年現在も、生成 AI も LLM も ambient scribe も、すべてこの通知の延長線上で運用されている。「AI が誤った下書きを書いた」も「AI が患者メッセージで誤った回答を作った」も、最終的に承認した医師の責任になる。

これを「制限」と見るか「枕木」と見るかで、AI 導入の風景はまったく変わる。私は枕木だと思っている。最終責任が医師にあるからこそ、医師は AI を「自分の判断を補強する道具」として使える。逆に責任が曖昧なら、医師は AI を信用できず、患者も AI 出力を信用できない。

日本医師会 2026 年答申——「何を学ばせ、何を任せず、誰が責任を負うか」

2025 年 2 月に発足した日本医師会「AI の臨床利用に関する検討委員会」は、5 回の審議を経て、2026 年 4 月に答申「AI に関する臨床的課題と生命倫理について」 を発表した [14]。生産年齢人口減少下で AI を医療生産性向上の手段として位置付けつつ、医師に次のことを求めている。

医師は AI に「何を学ばせ、何を任せず、誰が責任を負うか」を明確化する必要がある。

このフレーズは、これからの 10 年の医療 AI 議論を貫く軸になると私は感じている。「全部 AI に任せる」でも「全部 AI を拒否する」でもない。任せる範囲を医師職が能動的に決め、その決定の説明責任を引き受ける、という立場だ。

日本の実装はどこまで来ているか——EndoBRAIN と Ubie

具体例で見てみよう。

オリンパスと名古屋大学・国立がん研究センターが共同開発した EndoBRAIN シリーズ は、2018 年 12 月に日本で初めて承認された AI 内視鏡医療機器だ [17]。大腸ポリープを自動で鑑別・検出する CADe/CADx で、2024 年 2 月には EndoBRAIN-EYE が診療報酬加算の対象になり、AI 医療機器として日本で初めて「保険の中で稼ぐ」段階に到達した。日本医学放射線学会の AI ソフト認証は 2026 年 4 月時点で 43 製品にまで広がっている。

外来の問診・トリアージ領域では Ubie 生成 AI が走っている [18]。2024 年 5 月の正式リリース以降、わずか半年で全 47 都道府県・1,800 以上の医療機関に導入され、第 3 回日本サービス大賞で厚生労働大臣賞を受賞した。慶應病院や九州大学病院も導入医療機関に名を連ねる。

ただし正直に言えば、日本ではまだ ambient AI scribe 専業実装の大規模ピボタル試験は行われていない(2026 年 5 月時点)。岡山大学病院の山本らが医学生の問診技術向上を AI 模擬患者で検証した非ランダム化比較研究 [11] が、日本発の数少ない臨床エビデンスだ。世界の RCT を読みつつ、日本独自のデータをこれから積み上げる段階にある。

規制マップ:日本 vs FDA vs EU AI Act

| 国・地域 | 規制枠組み | 状況 |

|---|---|---|

| 日本 | 医師法 17 条(1948)+ PMDA SaMD 手引き(2025 改訂) | AI 認証ソフト 43 製品。最終責任は医師 |

| 米国 | FDA AI/ML SaMD Action Plan + Predetermined Change Control Plan | 1995-2023 年に 690 件超 の機械学習対応医療機器を承認 |

| EU | EU AI Act(2024 年 8 月発効) | 医療目的 AI は ほぼ全て「高リスク」分類。全面適用 2027 年 8 月 |

| WHO | LMM Ethics & Governance Guidance(2024 年 1 月)[15] | 40 以上の勧告、5 領域に分類 |

日本の AI 医療機器承認数は約 60 件と FDA の 10 分の 1 以下にとどまる。これを「遅れ」と捉えるか「慎重さ」と捉えるかは、議論が分かれる。私は、医師法 17 条という基礎を持つ日本が、世界の試行錯誤を後追いで取り入れることでむしろ「安全な実装」に到達できる側にいると見ている。

患者として知っておきたいこと——AI が診察室にいる時、あなたは何を確認するか

ここからは、患者として外来に行ったときに知っておいてほしいことを書く。

「AI が同席する」の同意——確認したい 3 つのこと

ambient AI scribe を使う医療機関は今後増えていく。診察前に「AI が会話を録音して下書きを作ります、よろしいですか」と確認される時代が来る。そのとき確認してほしいのは次の 3 点だ。

- 録音データの保存と削除のルール——いつまで保存されるのか、診察後に削除を申し出られるか

- AI 出力を医師がチェックする工程の有無——「AI の下書きをそのまま使う」か「医師がカルテとして整える」か

- 拒否しても診療に支障がないこと——AI 同席の同意は完全に任意であるはずだ

これは新しい同意ではない。診察室の録音や医学生の同席にすでに似た仕組みがある。AI に拒否権を持つことは、患者の正当な権利だ。

AI が書いた紹介状を読むコツ

紹介状や検査結果説明書を AI が下書きする時代がもう始まっている。読むときのコツが 1 つある。「数字が具体的か」を見ること。

「中等度の脂肪肝です」より「FibroScan 8.5 kPa、軽度から中等度の線維化(F1-F2)が疑われます」のほうが、医師が AI の下書きをきちんと校閲した可能性が高い。逆に抽象的な表現ばかりが並んでいたら、医師がろくに見ずにサインした可能性がある——そのときは遠慮なく「これはどういう意味ですか」と聞いてほしい。

JAMA Network Open に掲載された 43 ヵ国 13,806 人の患者を対象とした多国横断研究 [10] では、患者の 72.9% が「医師主導の意思決定」を選好し、70.2% が「説明可能な AI」を求めた。AI が診療に入ることへの治療成果の正確性への信頼は 41.8% にとどまる。患者は AI を拒否しているわけではない。「医師が責任を持って使う AI」を望んでいる。

科学の現在地:わかっていること、まだわからないこと

わかっていること:

- ambient AI scribe は医師のバーンアウトを統計的に有意に減らす [2]

- 患者向け AI チャットボットは時に医師より共感的に応答する [4]

- 大規模医療システムで月 100 万回規模の AI 利用が日常化している [16]

まだわからないこと:

- 10 年使い続けたとき、医師の臨床判断力に何が起きるか

- AI 関与医療事故の法的責任の境界線(日本での確定判例なし)

- 日本人医師・日本人患者に欧米データがそのまま当てはまるか

これから出る答え:

- 日本での RCT(複数の大学病院で計画中)

- EU AI Act の本格適用後の規制実例(2027 年 8 月以降)

- 長期 deskilling のメカニズム解明

おわりに——AI は医師の代替ではなく、医師の余裕の道具である

世界では今、診察室で月 250 万回、AI が医師の隣に座っている。日本の医師法 17 条は「最終責任は医師」と明確に定めている。これは AI 普及のブレーキではなく、AI を安全に育てる枕木である。

患者として知っておきたいのは、AI は医師の代替ではなく、医師の余裕と共感を取り戻す道具だということ。そして、その余裕を何に使うかは、医師の選択次第である。

私自身、医療 AI コンサルティングの現場で経営層と話していると、「AI を入れれば全部解決する」という幻想と「AI を入れれば医師が要らなくなる」という別の幻想の両方に遭遇する。どちらも違う。AI は医師の良心を増幅する道具であって、置き換える道具ではない。診察室で医師があなたの目をしっかり見ているなら、その背景で AI が裏方として働いている可能性は、これからどんどん高まる。

そして、もしあなたの主治医がまだ AI を使っていなくても、それは「遅れている」のではなく「責任の重さを慎重に検討している」ということでもある。日本医師会の 2026 年答申はこう言った——医師は「何を学ばせ、何を任せず、誰が責任を負うか」を明確化する責任を負う、と [14]。

AI が同席する診察室の物語は、まだ始まったばかりだ。